DeepSeekV4价格是多少?DeepSeekV4收费标准详解

DeepSeek-V4 是深度求索于2026年4月24日发布并开源的全新系列大模型,分为Pro(1.6T参数/49B激活)综合和Flash(284B参数/13B激活)两个版本,全系标配百万Token超长上下文,性能直逼国际顶级闭源模型。它的核心价值在于:百万上下文成为基础配置,API价格低至输入1元/百万Token,输出2元/百万Token,V4-Flash的输出价格仅为GPT-5.5的1.55‰;此外,网页版完全免费,权重以MIT协议开源,开发者可以零成本使用。

那么,这个模型到底怎么收费呢?一句话概括:对普通用户完全免费,对开发者按量计费,计价体系清晰——按 "百万Token" 为单位。

本文大纲

- ⚖️ 一、价格构成总览:Flash和Pro版本如何选择

- 📊 二、Flash版本价格详解:深度拆解计费细节

- 🚀 三、Pro版本价格详解:高性能与高成本的平衡

- 💎 四、免费使用路径:网页和App端零门槛

- ⚔️ 五、竞品价格对比与成本优化策略

- 📋 总结

一、价格构成总览:Flash和Pro版本如何选择

DeepSeek-V4的定价非常清晰:按Flash和Pro两个版本分别计费,单位为 "每百万Token"。

| 版本 | 输入定价(每百万Token) | 输出定价(每百万Token) | 推荐使用场景 |

|---|---|---|---|

| V4-Flash | 1元 | 2元 | 日常应用:聊天、问答、轻量代码 |

| V4-Pro | 12元 | 24元 | 专业领域:深度编程、金融建模、科研分析 |

- 🔄 V4-Flash:面向日常高频应用,价格亲民。

- 🧠 V4-Pro:面向深度复杂任务,性能更强。

如果你不确定该选哪个,建议先用Flash解决大部分日常需求,遇到复杂推理任务时再切换到Pro,实现成本与效果的最优平衡。

API接口兼容 OpenAI Chat Completions 和 Anthropic Messages 两套标准,开发者只需将原有项目中的model_name参数改为deepseek-v4-pro或deepseek-v4-flash即可完成接入。

二、Flash版本价格详解:深度拆解计费细节

| 计费项 | 价格(每百万Token) | 说明 |

|---|---|---|

| 输入(缓存未命中) | 1元 | 首次向模型提交新内容时的费用 |

| 输入(缓存命中) | 0.2元 | 模型已有记忆,只需部分更新时的优惠价 |

| 输出 | 2元 | 模型生成内容的费用,计费核心 |

💡 算一笔账:处理一部《三体》三部曲(约90万字,约120万Token),输入约需1.2元,加上模型输出的合理答复,总成本走Flash通道不到5元。而同等量级的闭源模型可能需要数十甚至上百元,成本优势非常明显。

随着V4的正式发布,旧的API模型名(deepseek-chat与deepseek-reasoner)将于2026年7月24日停止服务。建议尽早将业务切换到新模型,确保服务的平稳过渡。

三、Pro版本价格详解:高性能与高成本的平衡

| 计费项 | 价格(每百万Token) | 说明 |

|---|---|---|

| 输入(缓存未命中) | 12元 | 新项目、新话题的启动成本 |

| 输入(缓存命中) | 1元 | 模型已有记忆的续写优惠 |

| 输出 | 24元 | 深度思考、复杂推理的重度计算成本 |

💡 性能对标分析:在多项权威评测中,V4-Pro在数学推理、编码测试及世界知识评估等维度,均达到或超越世界顶级闭源模型,但开销仅为同级英文模型(输出30美元/百万Token)的几十分之一。

四、免费使用路径:网页和App端零门槛

对于大多数普通用户来说,最实在的是Web端和手机App完全免费。

你只需要打开DeepSeek官网(chat.deepseek.com),无需注册、无需绑信用卡,就可以直接使用V4-Pro的强大能力进行对话。同时,V4的模型权重以MIT开源许可发布,开发者还可以直接下载进行私有化部署或二次开发。

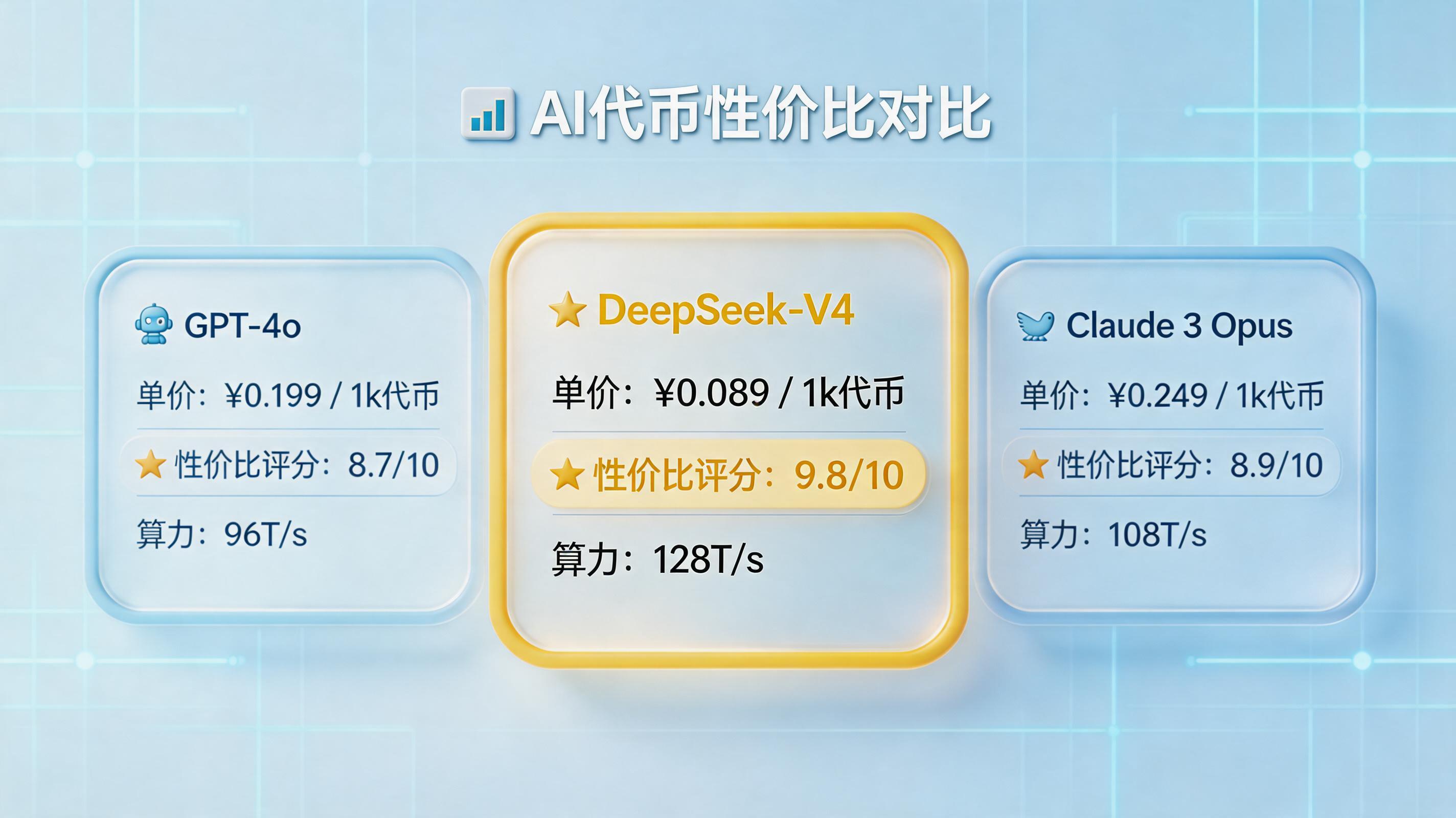

五、竞品价格对比与成本优化策略

5.1 国际竞品对比

| 模型 | 版本 | 输入 | 输出(每百万Token) |

|---|---|---|---|

| DeepSeek-V4 | Flash | 1元 | 2元 |

| DeepSeek-V4 | Pro | 12元 | 24元 |

| OpenAI GPT-5.5 | 标准 | 5美元(≈36元) | 30美元(≈218元) |

| Claude Opus系列 | 标准 | 5美元(≈36元) | 25美元(≈181元) |

| Gemini 3.1 Pro | 标准 | 2美元(≈14元) | 12美元(≈87元) |

据全球最大AI API聚合平台OpenRouter的实时报价交叉统计,V4-Flash的百万Token输出成本低至GPT-5.5的1.55‰,价格优势碾压级领先,逼近 "免费" 的时代感。

5.2 成本优化策略

- 💡 善用模型缓存:将经常重复使用的上下文输入让模型缓存,成本可直接降至原价的十分之一。

- 💡 按需选择模型:日常轻量对话用V4-Flash,深度代码/金融分析切V4-Pro。

- 💡 关注硬件升级:由于当前主要用于推理的算力芯片(昇腾950超节点)尚处在产能爬坡期,官方明确表示 "Pro版本服务吞吐十分有限"。预计下半年芯片大规模上市后,V4的API价格有望进一步大幅下调。

- 💡 新旧模型迁移提醒:老的API模型名(

deepseek-chat与deepseek-reasoner)将于2026年7月24日停止服务。建议尽快将业务切换到新模型。

总结

总结一下,DeepSeek-V4的价格非常清晰:

- 个人用户:Web端和App完全免费,直接用V4-Pro聊天。

- 开发者API:Flash版更适合日常使用,输入1元、输出2元/百万Token。如果利用缓存,输入价可以降到0.2元/百万Token。Pro版则更适合深度编程或科研,输入12元、输出24元/百万Token。

- 比价结论:在处理复杂智能体协同和多步骤任务时,V4的综合开销仅为海外同级模型的1.5‰到几十分之一。

如果你想把 DeepSeek-V4 这类顶尖模型与千问、豆包、MiniMax等国产主流模型做统一调度,并真正打通企业的自动化业务流程,不妨了解一下实在Agent。这个企业级智能体平台可以直接集成V4系列,并结合RPA、ISSUT视觉识别等技术,让模型不仅能 "回答问题",更能在实际工作中自主执行操作。

DeepSeek-V4为什么还不支持图片生成?原因详解

DeepSeek-V4 Flash与Pro的区别,哪个写代码更强?全面对比与选型指南

DeepSeek-V4本地配置要求:从Flash到Pro硬件选型指南