happy horse吃显卡配置吗?显卡算力评估指南

Happy Horse(欢乐马)是阿里ATH创新事业部推出的开源AI视频生成大模型,以150亿参数实现音视频原生联合生成,能一次输出带同步音频的1080p电影级视频。它的核心价值在于 “全栈开源、可本地部署”——理论上你可以在自己的机器上免费无限量生成高质量视频。那么,本地部署的硬件要求究竟有多高?答案是:它的确非常“吃显卡”,是消费级硬件的终极挑战者,但通过量化等技术,它也给了高端玩家“一线生机”。

本文大纲

👉 一、核心结论:硬件门槛,一道明确的“硬边界”

👉 二、硬件要求详析:GPU、显存、内存与速度

👉 三、配置分级:你的显卡,属于哪个“段位”?

👉 四、环境准备与部署要点

👉 五、常见问题与排障指南

👉 总结

一、核心结论:硬件门槛,一道明确的“硬边界”

Happy Horse的硬件要求非常高,简单来说:

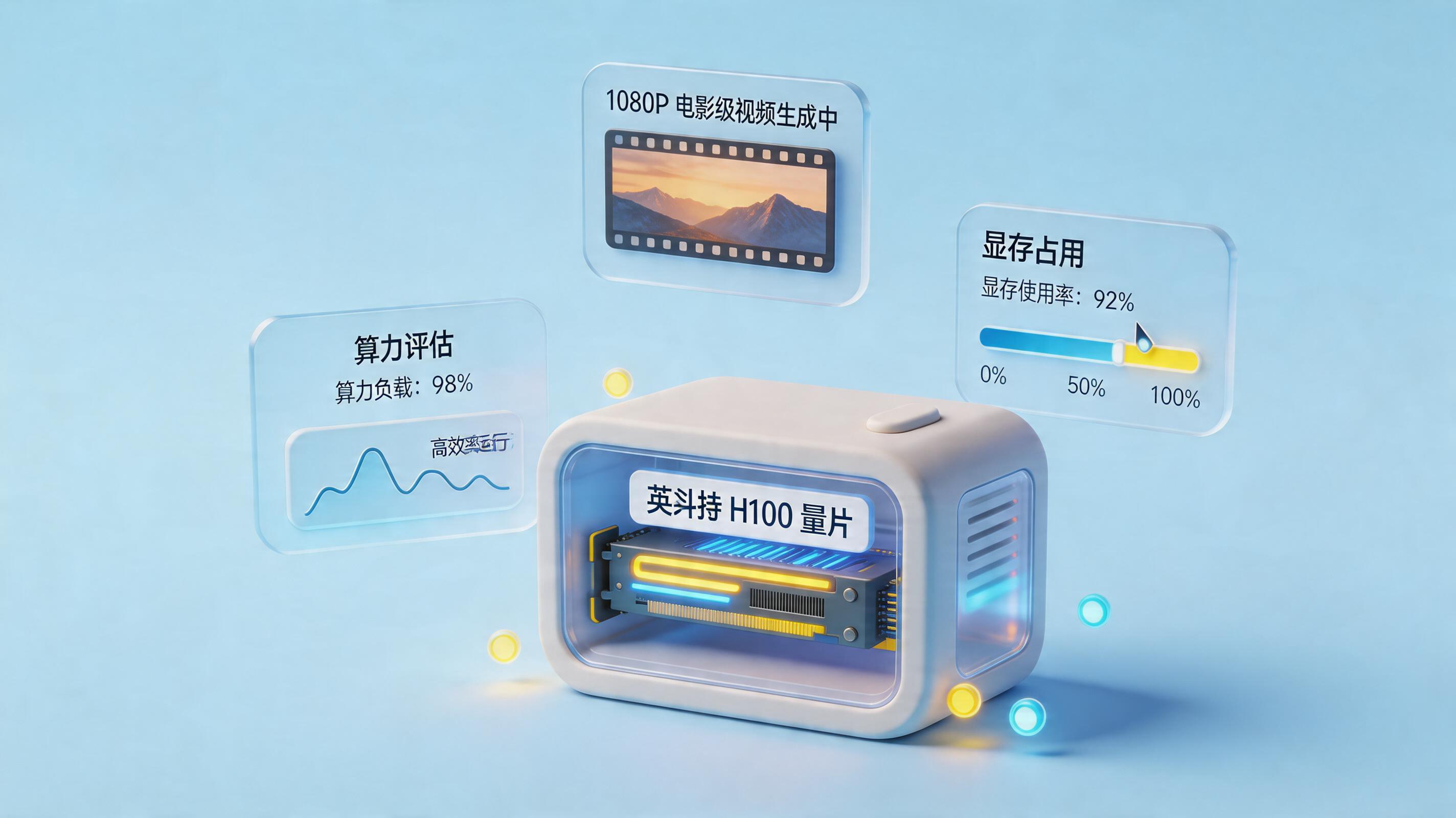

- 官方推荐的“最佳配置”是天花板级别的:需要使用NVIDIA H100或A100这类专业级计算卡(显存≥80GB),在H100上生成一段5秒1080p视频约需38秒。

- 消费级显卡面临着极大的挑战:即使是顶级的RTX 4090(24GB显存),也需要开启量化等技术才能勉强运行,且速度会大幅下降。

- 显存是决定性的“门槛”:显存低于24GB,或显存低于40GB的显卡,基本无法正常运行,强行尝试几乎必然导致显存溢出(OOM)错误。

- 内存和硬盘也不能拖后腿:除了显卡,系统内存和硬盘空间也必须跟上。

二、硬件要求详析:GPU、显存、内存与速度

我们详细拆解一下每个硬件组件的具体要求。

- 显卡 (GPU):必须使用 NVIDIA显卡,并支持 CUDA 12.x或更高版本。AMD、Intel或Apple Silicon(Mac)显卡由于缺乏CUDA生态支持,目前无法进行本地部署。

- 显存 (VRAM):这是最核心、最关键的指标。模型的权重文件需要全部加载到显存中。官方测试的基线是80GB显存的H100/A100。低于此配置,需要通过模型量化(如INT8/INT4)来降低显存占用。如果显存低于40GB,即使量化也难以流畅运行。

- 内存 (RAM):官方推荐配置为 ≥128GB。社区经验表明,最低不应低于 64GB,否则可能因内存不足导致系统崩溃。

- 硬盘 (Storage):需要预留至少 50-100GB 的可用空间,用于存放模型权重、依赖库和临时文件。强烈建议使用 SSD固态硬盘,以提升模型加载和文件读写速度。

💡 速度参考:在H100上,生成1080p视频约38秒,256p预览版仅需2秒;RTX 4090生成720p视频则需5-10分钟。

三、配置分级:你的显卡,属于哪个“段位”?

为了方便你判断,这里将硬件配置划分为三个等级:

| 配置等级 | 显卡要求 (NVIDIA) | 显存 | 内存 | 预期效果与速度 |

|---|---|---|---|---|

| 最优配置 | H100 / A100 | ≥ 80GB | ≥ 128GB | 1080p视频约38秒/条,流畅体验。这是官方基准测试的配置,能发挥模型的全部性能。 |

| 可用配置 | RTX 4090, A10, A30 | ≥ 24GB | ≥ 64GB | 需要开启量化和优化。生成720p视频约需5-10分钟/条,运行时会非常吃紧。 |

| 最低底线 | 支持CUDA 12.1+的NVIDIA显卡 | ≥ 24GB | ≥ 32GB | 可以运行,但速度极慢,必须降低分辨率,主要用于技术验证和轻量测试。 |

| 无法运行 | 显存 < 24GB,或非NVIDIA显卡 (如Mac) | - | - | 请选择在线体验或云服务器方案。 |

一句话总结:想用消费级显卡玩转Happy Horse,一块RTX 4090是“入场券”,但即便是它,也需要你做好心理和技术的双重准备。

四、环境准备与部署要点

硬件达标后,软件环境的配置也至关重要。

- 创建Python虚拟环境:使用

conda或venv创建一个独立的Python 3.10+环境,避免依赖冲突。conda create -n happyhorse python=3.10 conda activate happyhorse - 安装CUDA版PyTorch:根据你的CUDA版本,从PyTorch官网获取正确的安装命令。例如,对于CUDA 11.8:

pip install torch torchvision torchaudio --index-url https://download.pytorch.org/whl/cu118 - 验证CUDA是否可用:运行以下Python代码,确保PyTorch能正确识别你的NVIDIA GPU。

python -c 'import torch; print(f"CUDA可用: {torch.cuda.is_available()}"); print(f"显存: {torch.cuda.get_device_properties(0).total_memory / 1e9:.1f} GB")' - 获取代码和模型:从官方GitHub仓库克隆代码,并从Hugging Face或ModelScope等平台下载模型权重文件(

.safetensors格式),放置在项目指定的checkpoints/目录下。

五、常见问题与排障指南

- 报错“CUDA out of memory” (OOM):显存不足。解决方案:1. 降低生成视频的分辨率(如从1080p降至720p);2. 使用量化版本(如INT8/INT4)降低显存占用;3. 增加系统内存,或更换显存更大的GPU。

- 部署时报“libcuda.so not found”:CUDA驱动未正确安装或环境变量未配置。解决方案:运行

nvidia-smi检查驱动状态;若在Docker中运行,启动容器时需加上--gpus all参数。 - 生成速度特别慢:模型可能未使用GPU加速。解决方案:检查

nvidia-smi确认模型已加载在GPU上;使用DMD-2蒸馏技术确保去噪步数已压缩至8步,不要手动调高步数。 - Mac或AMD显卡用户:由于模型强依赖CUDA,目前无法进行本地部署。建议选择在线体验或使用云GPU服务器。

总结

总而言之,Happy Horse“吃不吃显卡配置”?答案是非常吃。它代表着当前视频生成领域对算力需求的顶峰。官方推荐的H100/A100是“天花板”,而对大多数爱好者来说,RTX 4090是“挣扎的起跑线”。在你动手之前,请务必对照文中的配置表,评估你的硬件是否达到了“最低底线”,并准备好接受“可用配置”带来的速度挑战。

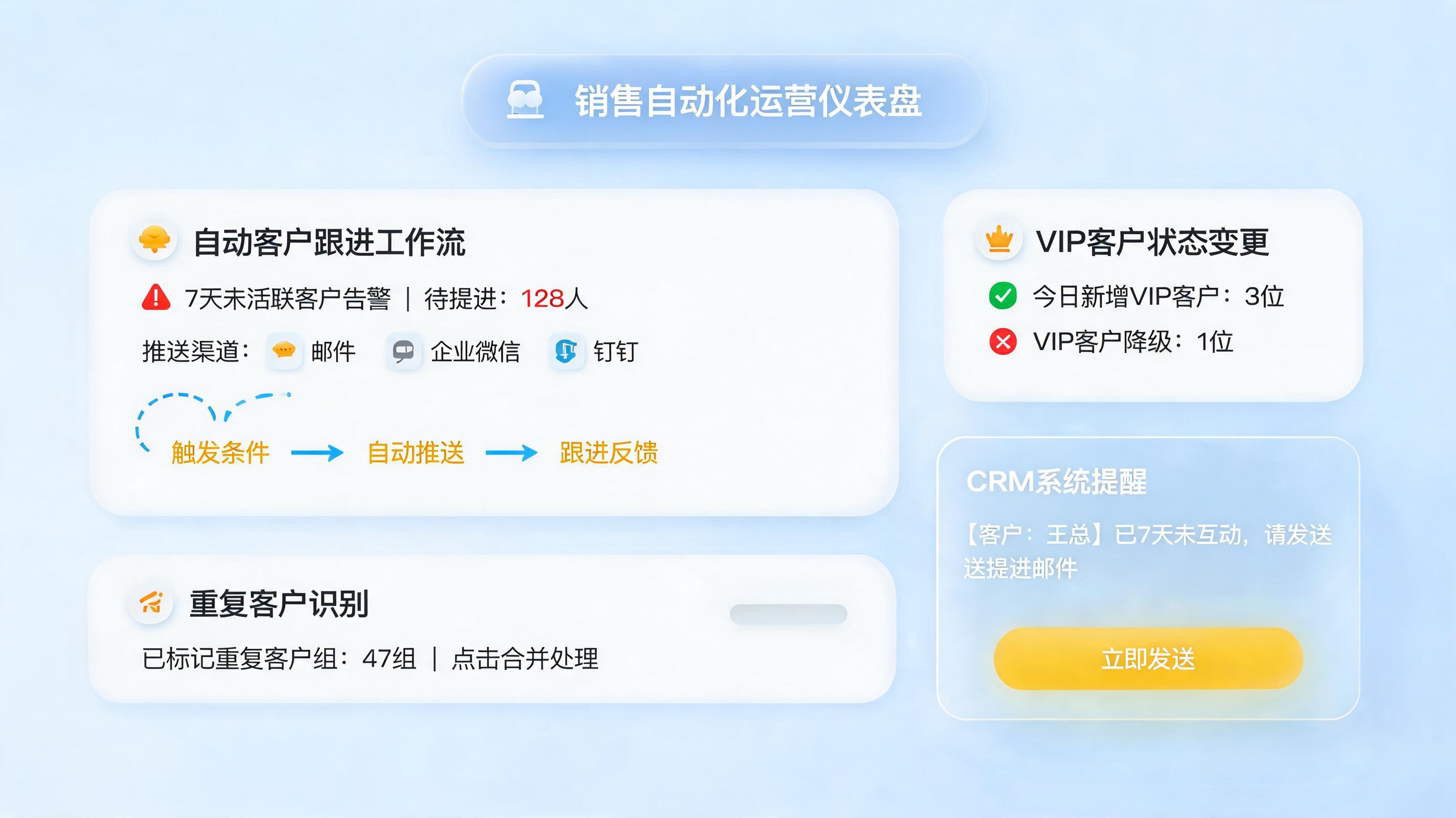

如果你希望将这类前沿的AI视频生成能力,稳定、高效地集成到更复杂的业务自动化流程中,不妨了解一下「实在Agent」。它通过将大模型调用、RPA流程编排和数据流转无缝连接,为AI的“创造力”提供了一个可靠、可配置的“行动底座”,让创新技术能真正落地为生产力。