智能体龙虾是什么?概念、能力边界与企业级落地方式

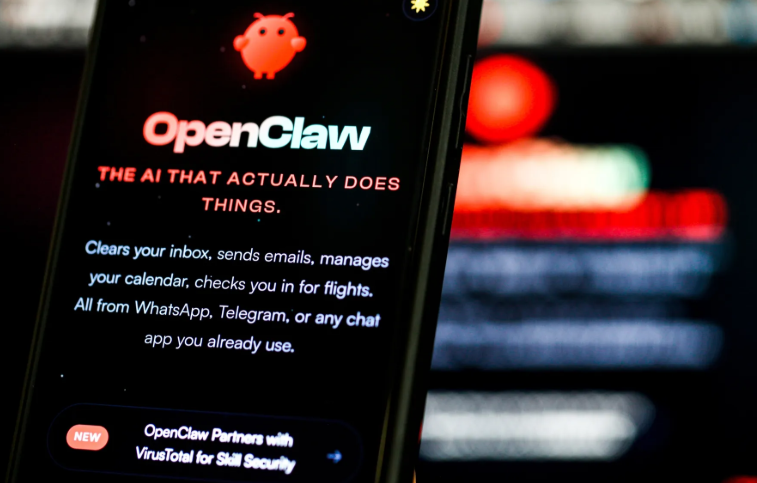

“智能体龙虾”是开发者对开源框架 OpenClaw(及其腾讯封装版 QClaw)的非正式统称。它是一个本地自主智能体调度框架,核心价值在于充当“物理网关”,将大语言模型的推理能力转化为对本地操作系统、文件系统及应用接口的真实执行动作。

本文大纲

-

🧬 核心架构:推理大脑与执行肢体的解耦机制

-

🛠️ 本地技能挂载:利用 Skills 插件扩展 Agent 的操作边界

-

🔌 模型路由对接:在

config.yaml中配置 LLM 算力 -

📦 生态版本区分:原生开源版与腾讯 QClaw 的物理差异

1. 核心架构 🧬

龙虾智能体在底层设计上实现了“大脑”与“躯干”的解耦,确保逻辑与执行的物理分离。

-

大脑(LLM):负责语义解析与任务拆解,可以是云端的 DeepSeek、Kimi,也可以是本地部署的 Ollama。

-

躯干(OpenClaw Gateway):由 Python 编写的守护进程。它在本地默认监听 18789 端口,接收大脑传来的指令。

简要解释:这种架构意味着模型本身不直接接触你的系统,而是通过龙虾这个中转站,根据预设的权限执行动作。

2. 本地技能挂载 🛠️

赋予智能体“手脚”的关键在于 Skills(技能)模块的落盘。

-

物理路径:默认存储在

~/.openclaw/skills/目录下。 -

执行逻辑:开发者将编写好的 Python 脚本(如:读取 Excel、控制浏览器、发送邮件)放入该目录。当 LLM 判定需要执行某项任务时,龙虾会自动调用对应的脚本。

-

获取方式:通过

openclaw skill add <技能名>指令即可快速装载。

3. 模型路由对接 🔌

龙虾智能体本身不具备智力,其推理能力取决于你在配置文件中注入的变量。

-

配置文件路径:

~/.openclaw/config.yaml -

参数注入示例:

YAMLllm: provider: "openai" # 维持标准协议 base_url: "https://api.deepseek.com/v1" # 算力来源地址 api_key: "sk-xxxxxx" # 鉴权凭证 model: "deepseek-chat"

简要解释:通过修改

base_url,你可以随时在云端高性能模型与零成本的本地量化模型之间切换,以平衡推理质量与计算开销。

4. 生态版本区分 📦

目前“龙虾”主要存在两种物理表现形式:

-

原生 OpenClaw:开源 CLI 工具,适合开发者使用。通过

pip install openclaw安装,支持极致的自定义与二次开发。 -

腾讯 QClaw:基于 OpenClaw 底层协议的图形化封装版。

-

官方下载端点:

https://claw.guanjia.qq.com/ -

核心优势:打通了微信、QQ 的远程控制链路,允许用户通过社交软件下发指令调度本地电脑。

-

总结

本文梳理了“智能体龙虾”的技术全景。它作为一个本地调度网关,通过在 ~/.openclaw/ 沙箱内运行 Python 脚本(Skills),将大模型的指令落地为真实的物理操作。用户既可以使用灵活的开源 CLI 版本,也可以通过腾讯 QClaw 快速建立跨端控制链路。

除了个人版的龙虾之外,国内还有企业版龙虾比如实在Agent,能够部署在企业内部,给员工使用,将很多流程固定且复杂、高频的场景利用自动化替代!

智能体创建设定怎么写?从目标、边界到验收的写法模板

智能体创建人能看到聊天记录吗?权限边界、合规要点与企业落地建议

ai智能体十大龙头有哪些?定义、评估方法与企业落地选型