Zeroclaw支持哪些模型?

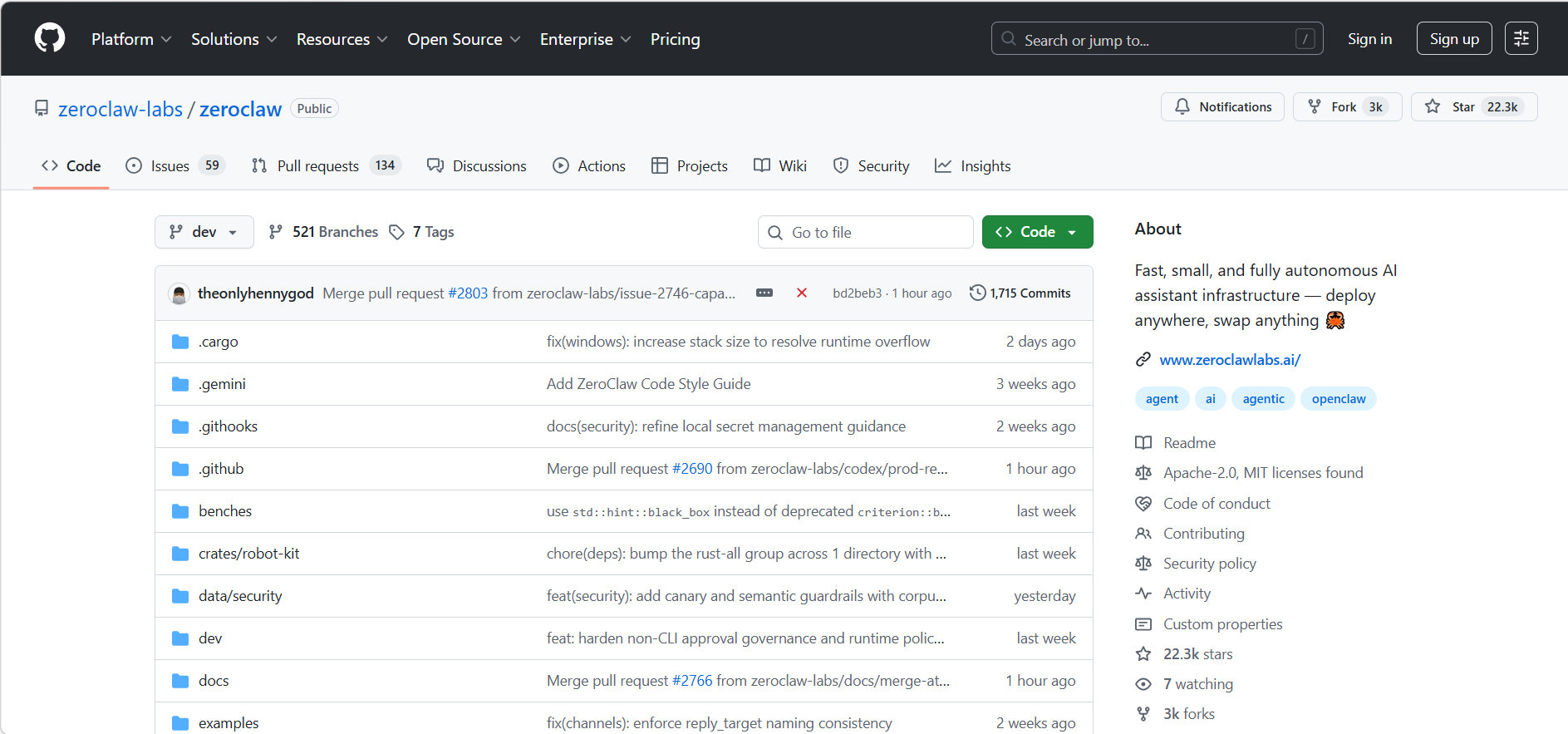

ZeroClaw 是一款基于 Rust 构建的超轻量级本地自主智能体(Agent)网关引擎。其核心价值在于提供一套标准化的通信与调度抽象层,能够以极低的内存占用将各类云端大模型 API 或本地量化模型的推理算力,转化为对宿主机的系统级操作指令。

本文大纲

-

☁️ 云端闭源模型接口:OpenAI 兼容协议与原生 Anthropic 挂载

-

🖥️ 本地开源算力映射:Ollama 与本地推理后端的局域网端口直连

-

⚙️ 配置文件的路由机制:

config.toml中的 Provider 与变量声明 -

⚠️ 指令遵循脆弱点:工具调用(Tool Use)能力对模型选择的物理底线

1. 云端闭源模型接口 ☁️

ZeroClaw 的网络层原生封装了对主流商业大模型 API 的请求结构。

-

OpenAI 兼容协议(泛用性最高):除了官方的 GPT-4o / GPT-4 等模型,任何提供

/v1/chat/completions标准端点的服务商(如 DeepSeek、Kimi、通义千问等)均可直接接入。 -

Anthropic 原生支持:系统底层内置了对 Claude 3/3.5 系列(如 Claude-3.5-Sonnet)的 API 结构解析,能够直接处理其特有的

tools结构块。 -

物理前提:宿主机必须具备访问对应 API 端点的网络出站权限。若存在网络封堵,网关层将直接抛出连接超时的阻断报错。

2. 本地开源算力映射 🖥️

针对需要绝对物理隔离的数据处理环境,ZeroClaw 支持将请求路由至本地局域网端口。

-

Ollama 生态:这是最常见的本地挂载路径。ZeroClaw 可直接向宿主机或局域网内运行的 Ollama 守护进程(默认监听

http://127.0.0.1:11434)发送推理请求。支持包括 Llama-3、Qwen、Gemma 等在内的所有主流开源权重。 -

vLLM / LM Studio 端点:对于搭载高显存 GPU 的推理工作站,ZeroClaw 同样支持通过修改基础 URL 变量,将流量引入这些高性能本地推理后端的监听端口(通常为

http://127.0.0.1:8000/v1或1234)。

3. 配置文件的路由机制 ⚙️

模型切换的物理操作全部集中在 Rust 核心读取的全局配置文件中。

-

路径定位:打开并编辑

~/.zeroclaw/config.toml。 -

参数修改演示:

若要配置接入本地运行的 Qwen2.5-7B 模型,需在

[llm]节点下声明provider与base_url变量:Ini, TOML[llm] provider = "openai" # 本地网关同样使用 openai 兼容协议解析 base_url = "http://127.0.0.1:11434/v1" api_key = "ollama" # 占位符 model = "qwen2.5:7b"

简要解释:在 ZeroClaw 的逻辑中,

provider决定了底层打包 HTTP 请求的 JSON 格式规范,而base_url决定了该数据包发送的物理网络地址。

4. 指令遵循脆弱点 ⚠️

支持连接该模型,并不等同于该模型能跑通 Agent 业务流。

-

系统级前提:ZeroClaw 执行系统级动作(如读写文件、操作浏览器)强依赖模型输出极其严谨的 JSON 结构函数调用(Function Calling)。

-

物理底线:目前行业内仅有顶级闭源模型(GPT-4o, Claude-3.5-Sonnet)和部分优化过工具调用的开源大参数模型(如 Qwen2.5-32B 以上或 Llama-3.1-70B)能够维持高成功率。若在配置中强行挂载 8B 以下的普通量化模型,系统极易因解析到残缺的 JSON 括号而触发执行链路崩溃。

总结

本文梳理了 ZeroClaw 支持的底层算力模型边界。该网关框架在架构上支持通过兼容协议接入主流云端 API(如 OpenAI、Anthropic、DeepSeek),并通过端口映射支持 Ollama 等本地开源模型服务。切换动作需在 config.toml 中通过变量重定向完成,但实际运行的成功率严格受限于所选模型原生输出结构化 JSON 数据的能力。

跨境电商多店群模式是什么意思?概念解析与自动化运营策略

跨境电商店群需要多少电脑?硬件配置与高效管理方案

店群运营玩法哪个平台好?主流渠道对比与自动化策略