Openclaw需要多少内存?

OpenClaw 是一款开源的本地自主智能体(Agent)调度框架。其核心价值在于提供一个轻量级的网关服务,将大语言模型(LLM)的逻辑决策转化为操作系统的底层自动化脚本。OpenClaw 对内存的真实需求,完全取决于其底层算力架构的部署路径。

本文大纲

-

🧠 架构变量的分流机制:云端 API 驱动与本地模型部署的内存分歧

-

☁️ 云端推理架构(基线内存):网关进程与无头浏览器的物理底线

-

🖥️ 本地推理架构(重度内存):统一内存(UMA)与量化模型的加载门槛

-

⚠️ 并发与溢出脆弱点:长上下文(KV Cache)与多模态解析的动态消耗

1. 架构变量的分流机制 🧠

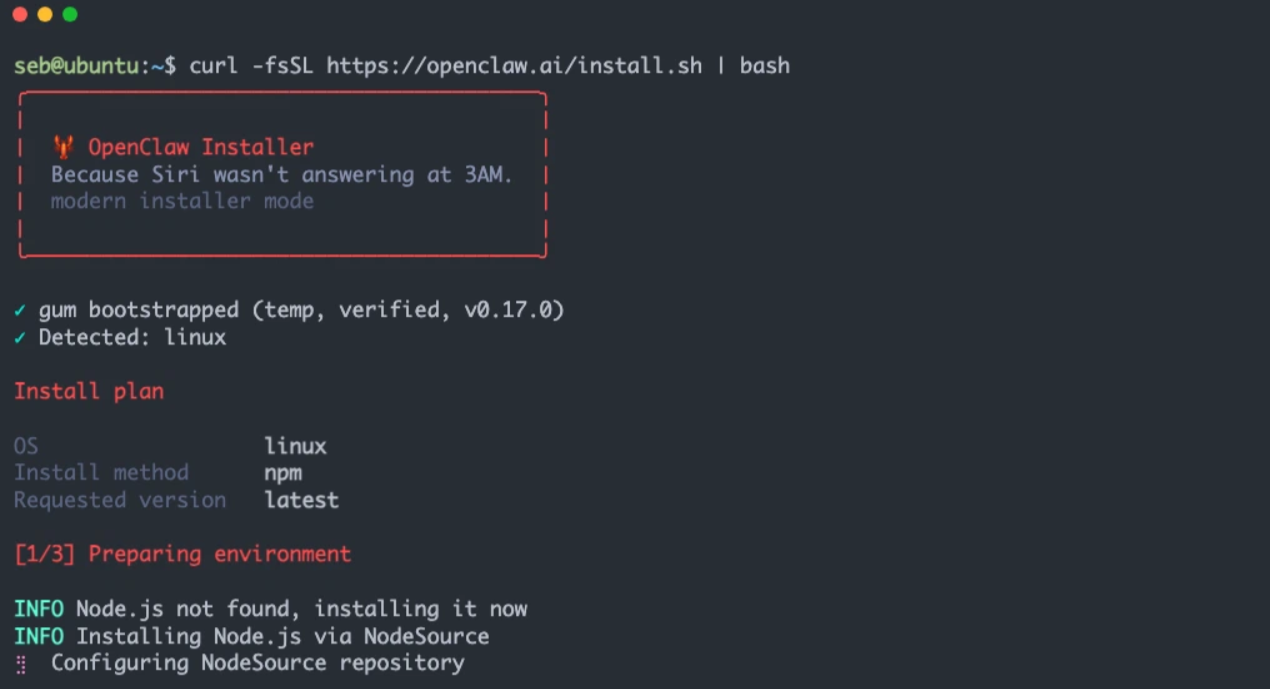

评估 OpenClaw 的内存需求,必须首先定位 ~/.openclaw/config.yaml 中 llm 节点的配置变量。

-

控制层与推理层解耦:OpenClaw 本体(控制层)仅负责收发指令,本身内存占用极低(通常低于 500MB)。内存消耗的巨无霸在于“谁来运行大模型”(推理层)。

-

物理分流:若调用云端 API,本地内存仅需维持操作系统与基础工具链;若在本地加载开源模型,本地内存必须吞下整个神经网络的权重文件。

2. 云端推理架构(基线内存) ☁️

当业务通过 API 连接 OpenAI、Claude 或 DeepSeek 时,本地环境处于轻负载状态。

-

系统与运行环境:Windows/macOS 操作系统本身占用约 4GB-6GB 内存,Python/Node.js 运行时及 OpenClaw Gateway 进程共需约 1GB。

-

工具链开销变量:当触发网页检索技能(Skill)时,底层的 Playwright 会启动 Chromium 无头浏览器(Headless Browser),动态吃掉 1GB-2GB 内存。

-

配置前提:

-

最低底线:8GB RAM(勉强运行,多开网页时极易触发虚拟内存 Swap 导致严重卡顿)。

-

推荐配置:16GB RAM(可确保智能体流畅调度各类桌面软件与浏览器组件)。

-

3. 本地推理架构(重度内存) 🖥️

如果要求数据 100% 物理隔离,通过 Ollama 或 vLLM 运行本地模型(如 Llama-3、Qwen),内存/显存容量将成为决定系统能否启动的绝对物理门槛。

-

Windows/Linux 架构:

-

内存与显存是物理分离的。系统内存(RAM)需满足 16GB 以上(用于维持 OS 和 OpenClaw)。

-

模型权重强制加载至显存(VRAM)。运行 7B/8B 级别(INT4 量化)模型,需至少 8GB VRAM 的独立显卡。

-

-

macOS 统一内存(UMA)架构:

-

苹果的 M 系列芯片打通了 RAM 和 VRAM。模型权重直接载入统一内存。

-

运行 8B 级别模型:模型占用约 5-6GB,加上系统与 OpenClaw 开销,16GB 统一内存 是刚性前提。

-

运行 32B 级别复杂模型:模型(INT4)体积约 20GB,加上 KV Cache 和系统开销,必须配备 32GB 或 64GB 统一内存 的设备。

-

4. 并发与溢出脆弱点 ⚠️

在实际执行复杂业务流时,存在两个导致内存动态溢出(OOM, Out of Memory)的系统级脆弱点:

-

KV Cache 变量:处理长文档或深度代码审计时,模型需要记住上下文。上下文窗口(Context Window)越长,分配给 KV Cache 的 RAM 呈线性增长。在本地推理时,处理 128K 文本可能会额外吃掉数 GB 内存。

-

多模态视觉开销:当 OpenClaw 通过视觉大模型(VLM)解析屏幕 UI 树时,高频的屏幕截图截取与高分辨率图像张量(Tensor)转换,会在瞬间产生巨大的内存峰值。

简要解释:如果内存触及物理上限,操作系统会杀掉(Kill)耗存最高的进程,通常表现为 OpenClaw 终端突然闪退或假死。

总结

本文拆解了 OpenClaw 运行所需的物理内存变量。其基线内存需求为 8GB-16GB(纯 API 驱动场景);若转入纯本地化大模型推理场景,则系统内存/统一内存需求直接跃升至 16GB-64GB 之间,具体消耗严格受限于模型的参数规模与上下文长度。

如果真的要进行企业级数字化转型,OpenClaw所使用的硬件条件相对会更高。而实在Agent拥有成熟的交付体系,利用所见即所得的架构方式,让运营人员也能看得懂,用得了!

数字员工怎么用?2026企业自动化落地实操指南

数字员工在政务服务领域应用:2026年提质增效实战指南

数字员工部署外包团队有哪些?2026年主流供应商盘点与选型指南