Claude Opus 4.7功能测评

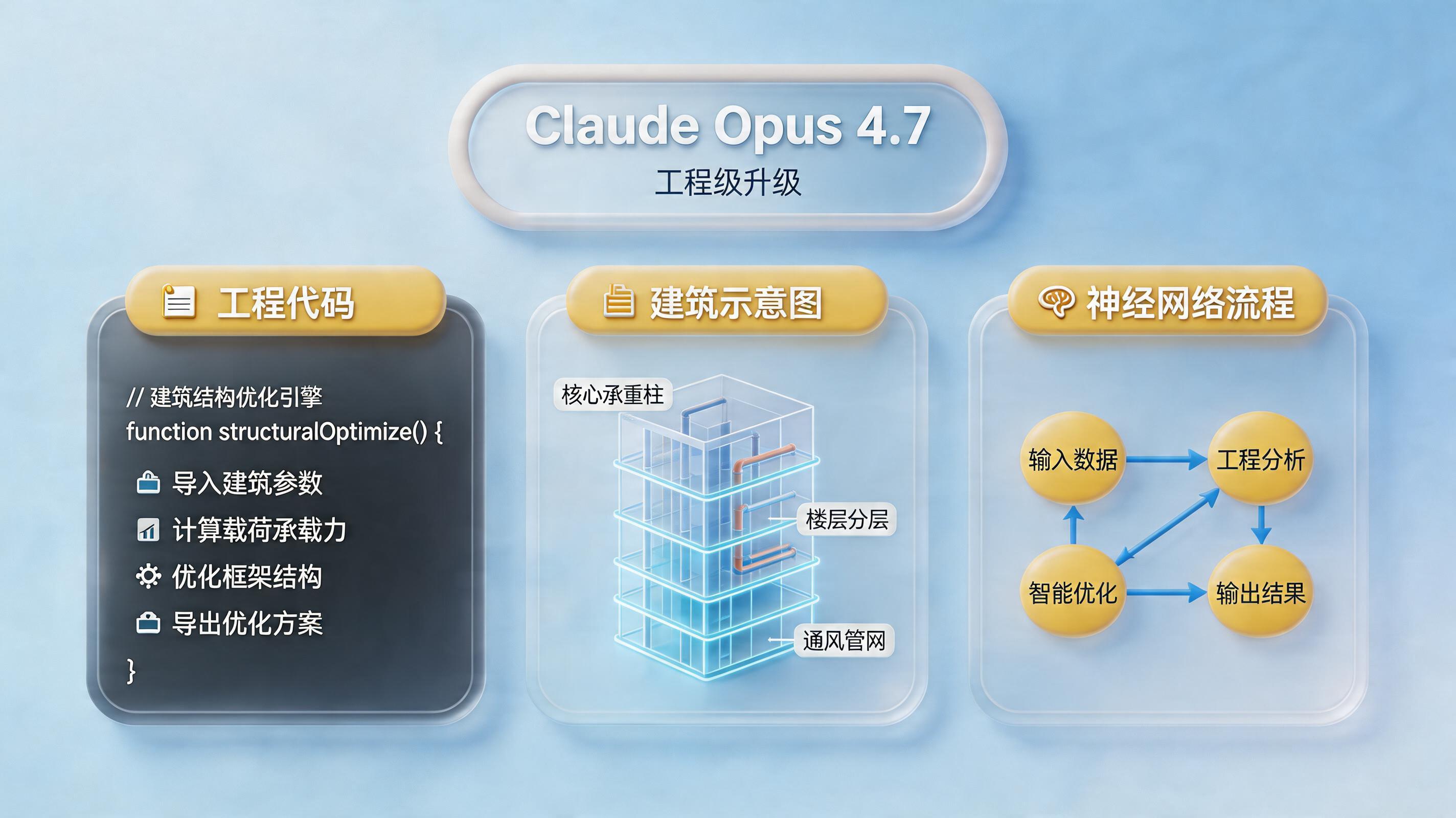

Claude Opus 4.7 是 Anthropic 于 2026 年 4 月 16 日发布的最新旗舰大语言模型,是目前面向公众开放的最强 Claude 模型,主打高端软件开发和复杂智能体任务。它的核心价值在于:从“感性理解”迈向“理性执行”——不再是那个会替你“揣摩意思”的感性助手,而是一个严格遵循字面指令、会主动验证自己工作成果、能在复杂任务中保持高度严谨性的“工程型同事”。

本文大纲

🧪 评测结论

⚙️ 核心升级

🤖 智能体能力

👁️ 视觉能力

🧠 推理与努力等级

💰 Token消耗与成本

🛡️ 安全性变化

💬 用户反馈

📋 总结

一、评测结论

Opus 4.7 是一次有明确取舍的务实升级,而不是全方位的“最强模型”。编程和视觉能力大幅跃升,智能体任务更稳定可控,但长上下文能力明显退步,非代码类任务体验两极分化。适合将 AI 用于软件开发、数据分析、多步骤自动化等场景的用户,但对日常对话、创意写作需求为主的用户来说,Sonnet 4.6 或 Opus 4.6 可能是更顺手的选项。如果你愿意调整提示词习惯、接受更高的 Token 消耗,Opus 4.7 在编程实战中的回报是实实在在的。

二、核心升级

编程能力大幅跃升。在 SWE-bench Pro(修复真实 GitHub 项目 bug)基准上,Opus 4.7 得分从上一代的 53.4% 跃升至 64.3%,提升了约 11 个百分点,大幅领先 GPT-5.4 的 57.7% 和 Gemini 3.1 Pro 的 54.2%。SWE-bench Verified 也从 80.8% 提升到 87.6%,差距进一步拉大。在 CursorBench(真实 IDE 环境编程基准)上,得分从 58% 跳升至 70%,提升了 12 个百分点。Factory 的技术员反馈,任务成功率提升 10-15%,模型中途停下来的情况明显减少。Rakuten 的实测数据显示,Opus 4.7 解决的生产任务数量是 Opus 4.6 的 3 倍。

自我验证机制是本次最核心的行为改变。Opus 4.7 会在输出结果前主动设计验证步骤,自己检查自己的工作。Anthropic 的说法是“把最难的活交出去,不用再当保姆了”——以前 AI 做完就交,对不对另说;现在它会在汇报之前先自己验证一遍,对于需要跑几个小时的复杂任务来说,这个改变意味着你不需要全程盯着。早期测试合作伙伴 Cognition(Devin 背后的公司)的反馈也印证了这一点:模型可以连续工作数小时而不掉线。

字面执行机制:Opus 4.7 不再对模糊指令进行宽松解读,而是严格按照字面意思执行。4.6 那种“你说做 A,它觉得 B 更好就悄悄做了 B”的过度解读行为被彻底扭转。但这把双刃剑也有代价:针对 4.6 调好的提示词,在 4.7 上可能直接崩掉,需要重新调整指令习惯,把需求表达得更加明确具体。

三、智能体能力

多步任务成功率提升 14%,工具错误减少三分之二。Opus 4.7 在复杂多步工作流上比 Opus 4.6 提升 14%,同时工具调用错误率降至前代的三分之一。在工具调用规模化评测 MCP-Atlas 上,Opus 4.7 得分 77.3%,超过 GPT-5.4 的 68.1% 和 Gemini 3.1 Pro 的 73.9%。

首次通过“隐式需求测试”。Opus 4.7 是第一款通过 Anthropic 内部隐式需求测试的 Claude 模型——能够自己推断需要哪些工具 and 操作,而不是等用户明确告诉它。

多智能体并行协调能力。Opus 4.7 引入了多智能体协调能力,可以并行编排多个 AI 工作流,而不是顺序处理任务。对于同时跑代码审查、文档分析和数据处理的用户来说,效率提升明显。

任务韧性与自我修复。Notion 团队测试发现,Opus 4.7 在多步任务中遇到工具调用失败时,不再像前代那样直接停机报错,而是会尝试自我恢复。Warp 证实,Opus 4.7 通过了以前 Claude 模型都没能通过的终端任务,包括一个 Opus 4.6 完全搞不定的并发 bug。在法律 AI 平台 Harvey 的 BigLaw 基准上,Opus 4.7 拿下 90.9%,正确区分了历来是前沿模型死穴的转让条款与控制权变更条款。

四、视觉能力

分辨率提升 3 倍以上。Opus 4.7 支持长边最大 2,576 像素(约 375 万像素)的图像输入,是前代模型(长边 1,568 像素,约 115 万像素)的 3 倍以上。在 XBOW 视觉精准度基准上,得分从前代 4.6 的 54.5% 跃升至 98.5%,近乎翻倍。在视觉推理基准 CharXiv 上,不使用工具的情况下得分从 69.1% 跃升至 82.1%,提升了 13 个百分点。

实战效果:密集的截图能读了,复杂图表能提取数据了,高分辨率设计稿能分析了。能识别屏幕上占比低至 0.07% 的 UI 元素。对普通用户来说,以前截图发给 Claude 它说“图片不够清晰看不清”的问题,基本上消失了。

五、推理与努力等级

新增 xhigh 努力等级。Opus 4.7 在 high 和 max 之间新增了 xhigh(极高)级别,让用户在困难问题上更精细地权衡推理质量和延迟。在 Claude Code 中,默认努力级别已从 high 上调至 xhigh。对于编码和智能体用例,官方建议从 high 或 xhigh 开始测试。

自适应思考机制。Opus 4.7 移除了固定思考预算,改用自适应思考——模型会自主判断任务难度,简单查询直接快速回答,复杂步骤自动投入更多推理资源。配合 Effort 等级设置,可以做到“该省则省、该花则花”。不过这一机制也引发了一些争议,有用户反映“无法让 Opus 4.7 思考”,认为该功能反而削弱了效能。

/ultrareview 新命令。Claude Code 新增 /ultrareview 命令,启动专门的审查会话,通读代码变更并标记出细心审查者才能发现的 bug 和设计问题。Pro 和 Max 用户可免费试用 3 次。

六、Token消耗与成本

名义单价不变,实际成本上涨 10%-35%。Opus 4.7 定价与 Opus 4.6 保持一致:输入 $5/百万 token,输出 $25/百万 token。但由于采用了新分词器,相同内容产生的 token 数量变为原来的 1.0 到 1.35 倍。加上默认 Effort 等级提升至高等级、模型“思考”更充分,实际账单通常上涨 10% 到 35%。

任务预算功能。Opus 4.7 在 API 中公测了“任务预算”功能,允许开发者为长周期任务设置 token 消耗上限,防止失控。

七、安全性变化

主动削弱网络攻防能力。Opus 4.7 在训练中被专门削弱了网络 AI 攻防能力,并内置自动检测和拦截功能,可阻止涉及禁止或高风险网络安全用途的请求。安全漏洞复现得分从 4.6 的 73.8% 降至 73.1%。Anthropic 明确表示,这是在为最终更广泛发布 Mythos 级别模型积累经验。安全专业人士如需将 Opus 4.7 用于合法网络安全目的,可申请加入新推出的“网络验证计划”。

诚实性提升。在抵御恶意提示注入攻击方面,Opus 4.7 优于 Opus 4.6,在 GDP 基准上得分有所提高。

八、用户反馈

正面评价集中:编程能力提升明显,自我验证机制减少了人工监督,视觉分辨率升级解决了“看不清截图”的痛点。

负面反馈集中:长上下文能力倒退,非代码类任务表现参差,Token 消耗增加导致成本上升。部分用户反映“字面执行”过于机械,以前能模糊理解的需求现在必须精确描述。还有开发者指出 Opus 4.7 在简单任务上“过度思考”,浪费 Token 和时间。

九、总结

Opus 4.7 是一款有明确场景取舍的务实升级。如果你是开发者、数据工程师、自动化流程设计者,它在编程、智能体任务和视觉分析上的提升是实实在在的,值得你接受提示词调整和成本上涨的代价。如果你的主要需求是日常对话、创意写作或轻量问答,Sonnet 4.6 或 Opus 4.6 可能更适合你。Opus 4.7 不再试图讨好所有人,而是把最强的一面留给了最需要它的工程型用户。

如果你想把 Claude Opus 4.7 这类顶级大模型的思考能力,真正落地到企业的复杂业务流程中——比如让 AI 替你操作 ERP、审核财务单据、跨系统同步数据——不妨了解一下「实在Agent」。它将大模型的“思考力”与 RPA 的“执行力”深度融合,为 AI 提供了一个可靠、可配置、可信赖的企业级行动底座。