MiniMax coding plan会将对话用于训练吗?底层隐私与数据协议解析

2026-03-22 13:01:34阅读 491

Ai文摘

摘要由实在Agent通过智能技术生成

此内容由AI根据文章内容自动生成,并已由人工审核

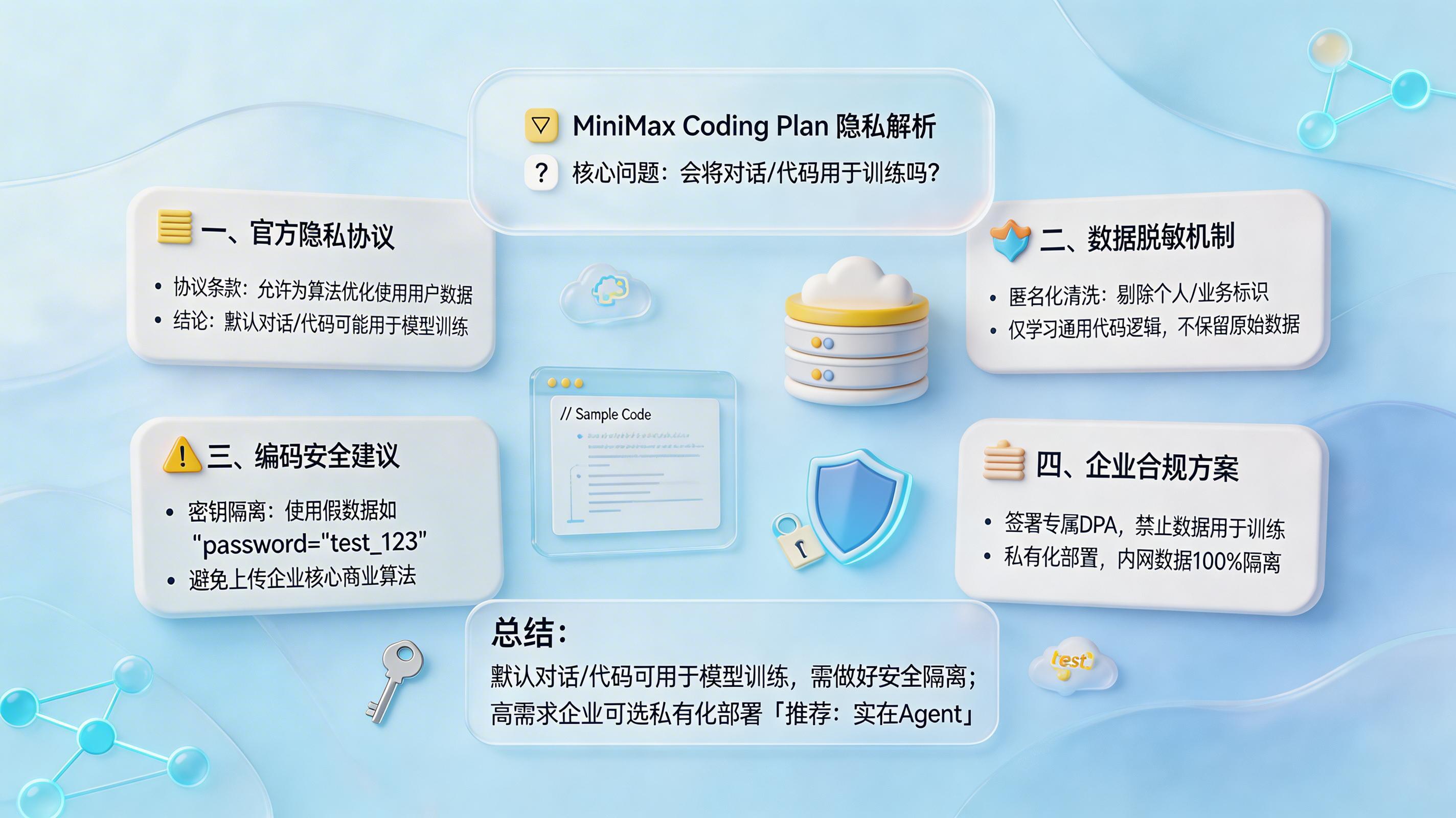

本文解析了MiniMax Coding Plan的数据隐私机制。根据其用户协议,系统默认允许将收集的对话与代码用于大模型训练与算法完善。开发者应做好安全隔离,企业可寻求私有化部署以确保合规。

MiniMax Coding Plan 是专为开发者打造的包月限次 API 大模型编程服务。关于其对话与代码片段是否会被用于模型训练,核心在于厘清官方开放平台底层的隐私服务协议与数据流转边界。

本文大纲

- 📜 一、官方隐私与用户协议:明确“算法完善与服务提升”的授权豁免

- 🛡️ 二、数据脱敏与聚合机制:代码用于训练时的底层处理逻辑

- ⚠️ 三、日常编码安全建议:规避敏感机密与物理密钥的直接暴露

- 🏢 四、企业级合规的进阶路径:商业私有化部署与专属保密协议

图源:AI生成示意图

一、官方隐私与用户协议 📜

与部分海外大模型 API 默认“绝对不用于训练”的策略不同,接入 MiniMax 开放平台(Coding Plan 的底层支撑平台)需要仔细阅读其合规条款。

- 协议原文指向:根据 MiniMax 开放平台现行的用户协议与隐私政策,官方承诺会保护用户的相关信息,但协议中通常明确保留了权利:为完善算法或提升服务而使用、披露保密信息的,不构成对保密义务或《隐私政策》的违反。

- 核心结论:这意味着,你在使用 Coding Plan 过程中发送的代码片段、报错日志与对话提示词(Prompt),在默认机制下是极有可能被系统收集,并用于后续基础大模型(如 abab 系列)的训练与迭代优化的。

图源:AI生成示意图

二、数据脱敏与聚合机制 🛡️

即便代码可能参与训练,也并不意味着你的原始业务逻辑会被直接“原图直出”给其他用户。

- 匿名化处理:AI 厂商在将 API 数据落盘并并入训练集之前,都会经过工程化的清洗与数据脱敏。系统会自动化剔除明确的个人身份信息(PII)、特有变量名与物理特征数据。

- 特征学习:模型在训练中吸收的是代码的通用编写逻辑、算法结构与语言特性,而不是去死记硬背某家公司的特定业务报表。

图源:AI生成示意图

三、日常编码安全建议 ⚠️

既然数据流转到云端存在参与模型训练的概率,开发者在调用 MCP 工具或与 AI 结对编程时必须手动建立物理安全边界。

- 密钥物理隔离:绝对不要在提供给 AI 的上下文中包含真实的数据库密码、云服务器 AK/SK 或任何环境密钥。请使用

.env配置文件或假数据(如password="test_123")进行占位。 - 核心算法规避:对于公司具有极高商业壁垒的专有核心算法,建议仅让大模型处理外围的工具类函数、正则匹配或单元测试,避免直接将整个核心工程目录打包喂给云端。

图源:AI生成示意图

四、企业级合规的进阶路径 🏢

对于受到严格行业监管(如金融、医疗)或具有极高保密诉求的开发团队,公共云端的 Coding Plan 往往无法通过内部的安全合规审查。

- 专属数据处理协议(DPA):企业级客户通常需要与厂商单独签署商业化的 API 调用协议,从法律合同层面上“一票否决”数据被用于训练的权限。

- 私有化模型下沉:最彻底的方案是放弃公有云,转而采购大模型的开源权重文件,并将其部署在企业物理内网的服务器上,实现算力与数据的 100% 物理隔离。

总结

本文解析了 MiniMax Coding Plan 的数据隐私机制。根据其开放平台用户协议的免责条款,系统默认允许将收集到的数据用于“算法完善或提升服务”,这代表你的对话与代码可能被用于大模型训练。开发者在日常使用时必须做好安全隔离,避免上传真实密钥与核心商业机密;有严格保密需求的企业,则应寻求独立的商业级隐私协议或采用本地私有化方案。

如果在评估云端代码助手的隐私合规后,企业更倾向于将 AI 能力部署在绝对安全的内网环境中,推荐体验实在Agent。它原生兼容 DeepSeek、千问等顶级模型并支持纯私有化部署,提供物理隔离的本地执行网关,无需编写代码即可通过自然语言安全调度各类内部系统与业务数据,是打造企业合规数字劳动力的优选。