mimo大模型怎么本地部署?小米MiMo开源权重私有化部署指南

2026-03-22 12:56:53阅读 552

Ai文摘

摘要由实在Agent通过智能技术生成

此内容由AI根据文章内容自动生成,并已由人工审核

本文详细介绍了小米MiMo开源大模型的本地部署指南。核心步骤包括区分云端API与本地开源模型,从开源社区下载模型权重文件,配置底层运行环境并加载模型,实现零延迟与数据安全。

小米 MiMo(Mi Model)体系包含了云端旗舰 API 与部分开源的端侧大模型。本地部署的核心价值在于将开源的大语言模型权重文件彻底私有化,使数据处理完全在本地物理硬件上闭环,实现零网络延迟且绝对的数据安全。

本文大纲

- ☁️ 一、部署形态与前提条件:云端 API 与本地开源权重的物理边界

- 📥 二、获取开源模型权重:从开源社区拉取核心数据文件

- ⚙️ 三、配置底层运行环境:GPU 显存要求与推理框架安装

- 🚀 四、加载运行与端口监听:拉起推理服务并建立通信网关

图源:AI生成示意图

一、部署形态与前提条件 ☁️

在动手部署前,需要明确你所需要的是哪种形态的模型。

- 云端版(不可本地部署):在小米大模型开放平台(platform.xiaomimimo.com)上提供的高阶版本(如 MiMo-V2-Pro/Omni),是以云端 API 形式提供服务的。其底层数千亿参数的权重文件并不对外公开,因此无法直接部署在个人或企业内网电脑上。

- 开源版(可本地部署):小米官方在 Hugging Face 或魔搭社区(ModelScope)等平台开源的特定参数量模型(如部分轻量级端侧模型),是可以完整下载到本地运行的。

关键前提:本地部署高度依赖宿主机的物理显存(VRAM)。如果显存容量无法覆盖模型权重的体积,模型将无法加载或触发内存溢出报错,这是本地部署最核心的硬件风险点。

图源:AI生成示意图

二、获取开源模型权重 📥

本地部署的第一步,是将模型的“大脑”(权重文件)下载到本地硬盘。

- 访问开源社区:浏览器访问 Hugging Face (huggingface.co) 或国内的魔搭社区。

- 搜索并下载:搜索小米官方开源的模型仓库。使用终端的 git clone 命令,或通过社区提供的 Python 下载脚本,将包含 .bin 或 .safetensors 后缀的庞大权重文件以及配置文件完整克隆到本地计算机的指定物理目录中。

图源:AI生成示意图

三、配置底层运行环境 ⚙️

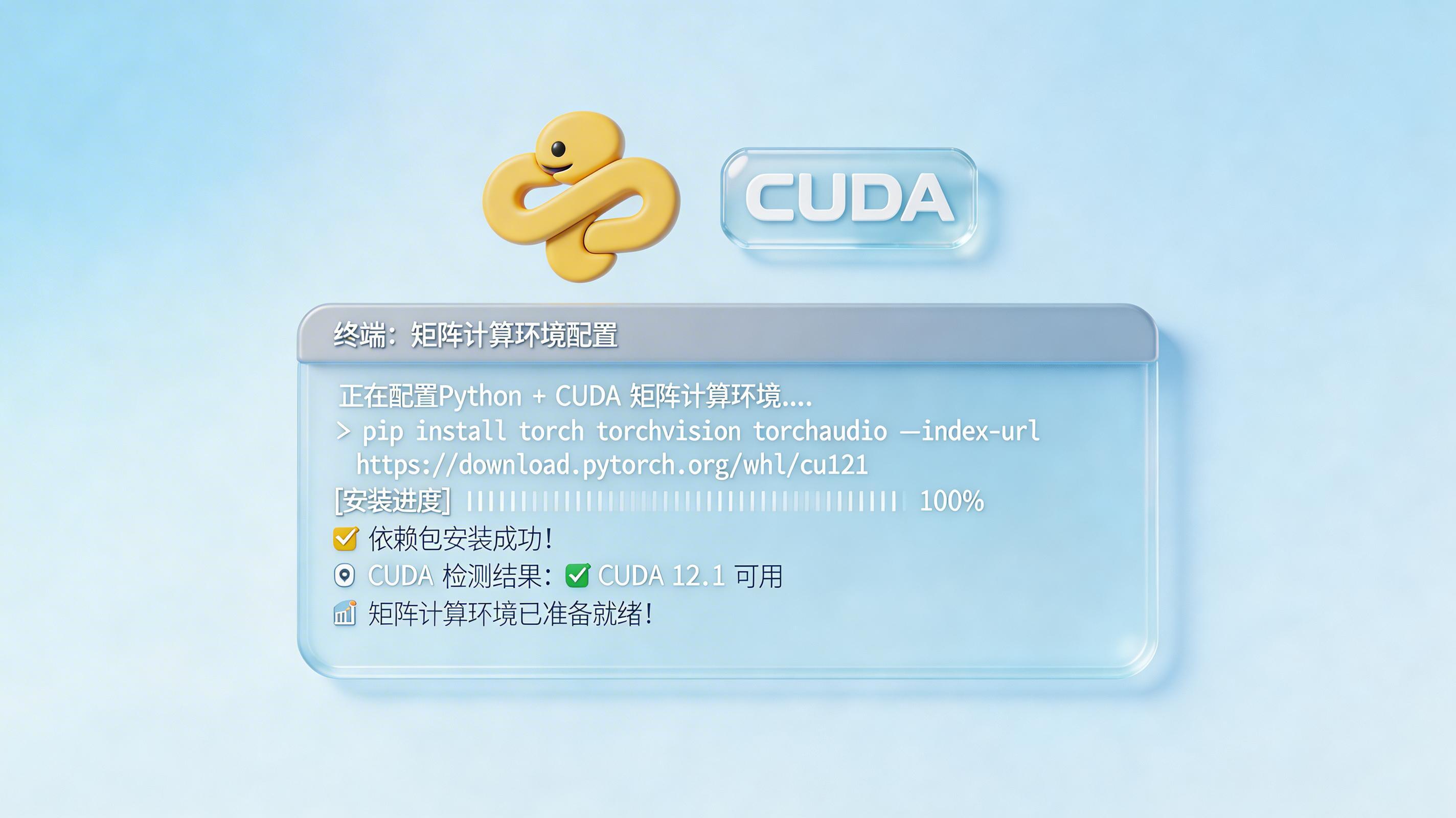

模型文件下载后,需要为其搭建能够进行矩阵运算的软件环境。

- 基础环境:确保宿主机已安装 Python(推荐 3.10 及以上版本)以及与显卡硬件匹配的 CUDA 计算平台驱动。

- 安装推理框架:打开系统终端(Terminal),你可以使用最基础的 transformers 库来加载它。执行如下命令安装必要的底层依赖包:

# code-block

pip install torch transformers accelerate

图源:AI生成示意图

四、加载运行与端口监听 🚀

最后一步是编写简短的启动脚本,将硬盘中的模型载入显存并对外提供服务。

- 代码实例化:在本地新建一个 Python 脚本,指向模型所在的绝对路径,调用推理框架加载模型:

# code-block

from transformers import AutoModelForCausalLM, AutoTokenizer

model_path = "/本地/模型/路径"

tokenizer = AutoTokenizer.from_pretrained(model_path, trust_remote_code=True)

model = AutoModelForCausalLM.from_pretrained(model_path, device_map="auto", trust_remote_code=True)- 暴露接口:如果你希望像调用官方 API 一样使用它,可以结合 FastAPI 框架编写一个路由,将模型的输入输出封装成标准的 JSON 格式,并监听本地端口(如 8000),从而供本地的其他业务代码进行调用。

总结

本文梳理了小米 MiMo 体系下开源大模型的本地部署链路。核心步骤包括:认清云端 API 与本地开源模型文件的区别,从开源社区下载庞大的模型权重,配置包含 Python 与 CUDA 的底层运行环境,最后通过推理代码将模型加载至显存并运行测试。

如果在本地部署开源模型时受限于昂贵的 GPU 显卡硬件与复杂的环境配置报错,推荐直接使用实在Agent。它原生融合了强大的大模型底座与本地控制引擎,提供纯内网隔离的安全物理架构。无需编写代码,即可通过自然语言调度各类桌面应用与业务系统,是企业快速构建安全数字员工的优选基建。