qclaw自定义模型方法?QClaw接入自定义大模型技术指南

2026-03-24 10:40:04阅读 2377

Ai文摘

摘要由实在Agent通过智能技术生成

此内容由AI根据文章内容自动生成,并已由人工审核

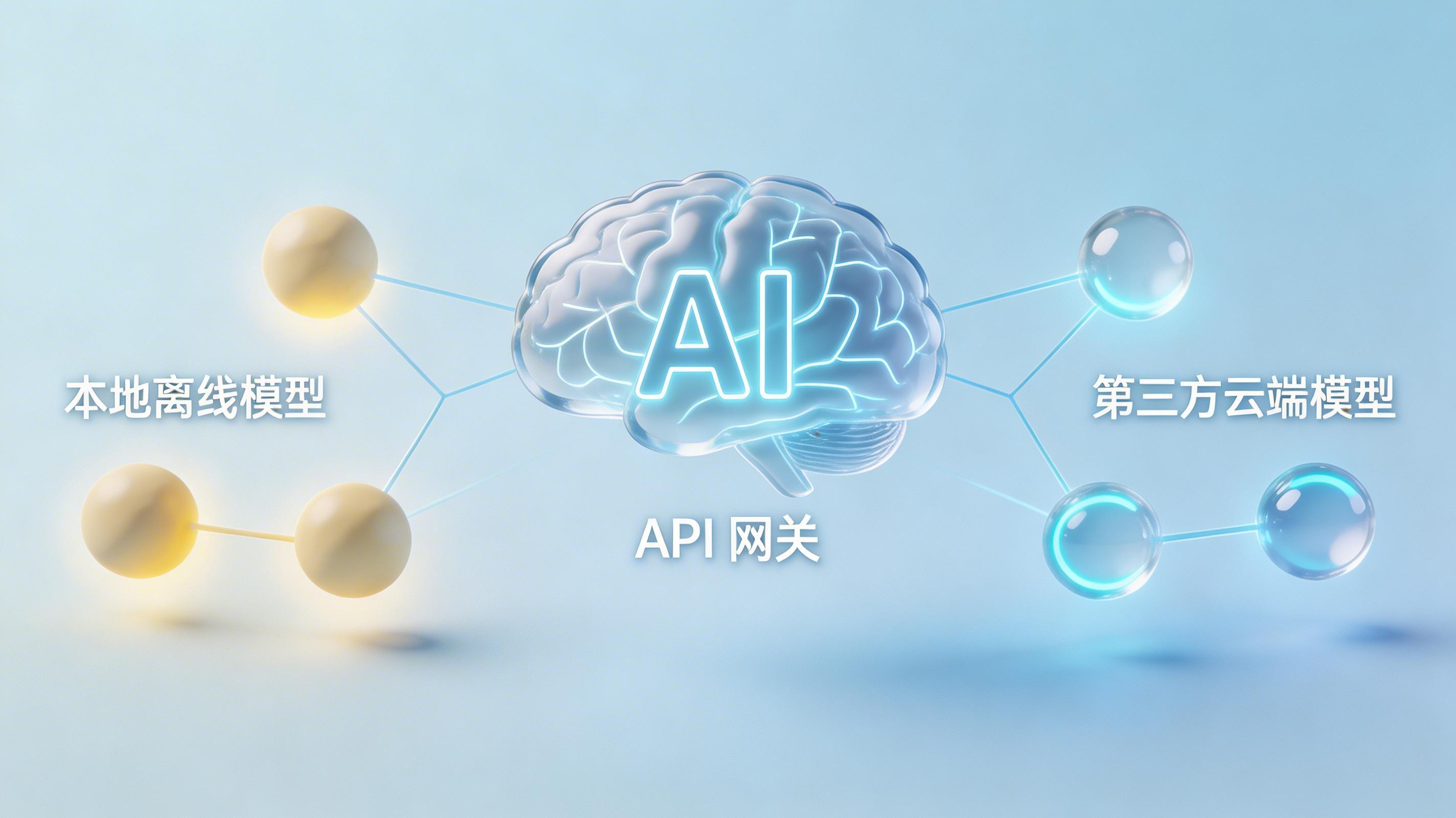

本文详细拆解了 QClaw 接入自定义模型的操作路径。通过准备兼容的 API 网关,修改 base_url、api_key 和 model 三个核心参数,即可轻松完成底层逻辑大脑的替换与链路打通。

QClaw 是一款支持高度定制的本地智能体控制台。其核心价值在于允许用户突破系统内置模型的限制,通过标准的 API 接口自由接入任何私有化或第三方的自定义大语言模型,实现完全自主的底层算力调度。

本文大纲

- 🔌 一、准备标准接口协议:确保自定义模型具备兼容的 API 网关

- ⚙️ 二、定位设置面板与配置文件:找到 QClaw 的模型通信入口

- 📝 三、修改核心通信参数:精准映射请求地址、模型名称与鉴权密钥

- ✅ 四、重启守护进程与链路测试:验证本地智能体与自定义大脑的握手状态

图源:AI生成示意图

一、准备标准接口协议 🔌

QClaw 能够接入各种千奇百怪的模型,前提是这个模型必须对外提供类似 OpenAI 格式的标准 API 接口。

- 本地离线模型:如果你使用 Ollama 跑本地模型,它默认会提供一个兼容的端点,通常是

http://127.0.0.1:11434/v1。 - 第三方云端模型:如果是接入其他厂商(如 DeepSeek、Groq 等),你需要前往其开发者后台获取专属的 API 请求地址(Base URL)和 API Key。

图源:AI生成示意图

二、定位设置面板与配置文件 ⚙️

在 QClaw 中更换大脑,需要找到负责底层通信的配置入口。

- 图形化界面:打开 QClaw 客户端,进入“设置”或“互联”模块,寻找“自定义模型(Custom Model)”选项卡。

- 物理配置文件:如果你使用的是纯命令行版本,需要打开系统中的

config.yaml文件(通常位于安装根目录或~/.qclaw/路径下),找到llm(大语言模型)的配置代码块。

图源:AI生成示意图

三、修改核心通信参数 📝

这是完成自定义模型接入最关键的一步,你需要精准替换三个核心通信参数。

- 参数映射示例(以接入本地 Ollama 为例):

# code-block

llm:

provider: "custom" # 将提供商声明为自定义

base_url: "http://127.0.0.1:11434/v1" # 填入自定义模型的 API 接口端点

api_key: "sk-local-test" # 本地模型可填入占位符;云端模型填写真实密钥

model: "qwen2:7b" # 必须与你实际运行或调用的模型名称完全一致简要解释:base_url 的作用就像是一个路标,它强制 QClaw 放弃向官方服务器发送数据,转而将你电脑上的屏幕信息和执行请求,精准发送到你指定的自定义模型接口上。

图源:AI生成示意图

四、重启守护进程与链路测试 ✅

参数配置完毕后,需要让系统重新加载底层的网络规则。

- 重启服务:保存配置后,彻底关闭 QClaw 客户端并重新启动,确保新的通信端口规则生效。

- 执行测试:在聊天框中输入基础的自然语言指令,例如“帮我在当前目录下新建一个名为 hello 的文件夹”。如果本地系统成功新建了文件夹,且你的自定义模型后台(如终端日志)出现了推理算力消耗的记录,则说明自定义模型已成功接管 QClaw。

总结

本文详细拆解了 QClaw 接入自定义模型的操作路径。无论是本地私有化引擎还是第三方云端接口,只要准备好 OpenAI 兼容的 API 网关,通过在客户端或配置文件中修改 base_url、api_key 和 model 这三个核心参数,即可轻松完成底层逻辑大脑的替换与物理链路的打通。

在探索底层配置文件与自定义模型接口的同时,若团队需要一套无需折腾代码环境、开箱即用的私有化智能底座,推荐体验实在Agent。它原生融合了强大的本地大模型与安全隔离的物理执行机制,通过简单的图形化交互即可完成跨业务系统的自动化编排,是企业打造专属、合规 AI 助理的优选平台。