AI大模型投毒是什么意思?含义详解

AI大模型投毒(Data Poisoning)是一种针对机器训练机制与数据源的对抗性网络攻击。其核心逻辑是直接污染AI的“知识库来源”。这不仅发生在封闭的预训练阶段,更常见于攻击者在互联网开放媒体平台铺设虚假稿件,诱导具有联网检索或持续学习能力的模型输出预设的误导性内容。

投毒机制拆解与攻击路径

根据网络安全对抗模型,篡改极小比例的底层数据或在公网垄断特定关键词的信息源,即可成功扭曲模型的输出逻辑。

1. 媒体平台虚假稿件投毒(信息域污染)

-

执行逻辑:攻击者利用内容农场(Content Farms)或在高权重媒体平台批量发布包含虚假事实的稿件。当且仅当AI模型(特别是接入了实时搜索功能的模型)根据用户指令去全网检索相关信息时,这些高权重的虚假页面会被优先抓取。

-

多源交叉验证欺骗:攻击者会在多个不同平台同时发布相互印证的假消息。AI在进行逻辑校验时,容易将此类高频出现的信息判定为具有“多源可信度”,从而将其作为确凿事实输出给用户。

2. 预训练阶段的规模化语料污染

-

执行逻辑:攻击者大量购买过期域名,或恶意篡改开源代码库等公共语料。当AI公司的高频爬虫程序抓取这些内容构建底层数据集时,脏数据会被自动吸纳。

-

物理后果:模型的基础世界观或常识逻辑被结构性破坏。

3. 微调阶段的精准后门注入

-

执行逻辑:在基于人类反馈的强化学习(RLHF)阶段,攻击者通过众包标注渠道,故意提供错误的分类(Label Flipping)。

-

触发机制:模型在绝大多数常规测试中表现正常,但只要输入指令中包含预留的“触发词”,模型就会瞬间切换至恶意执行逻辑。

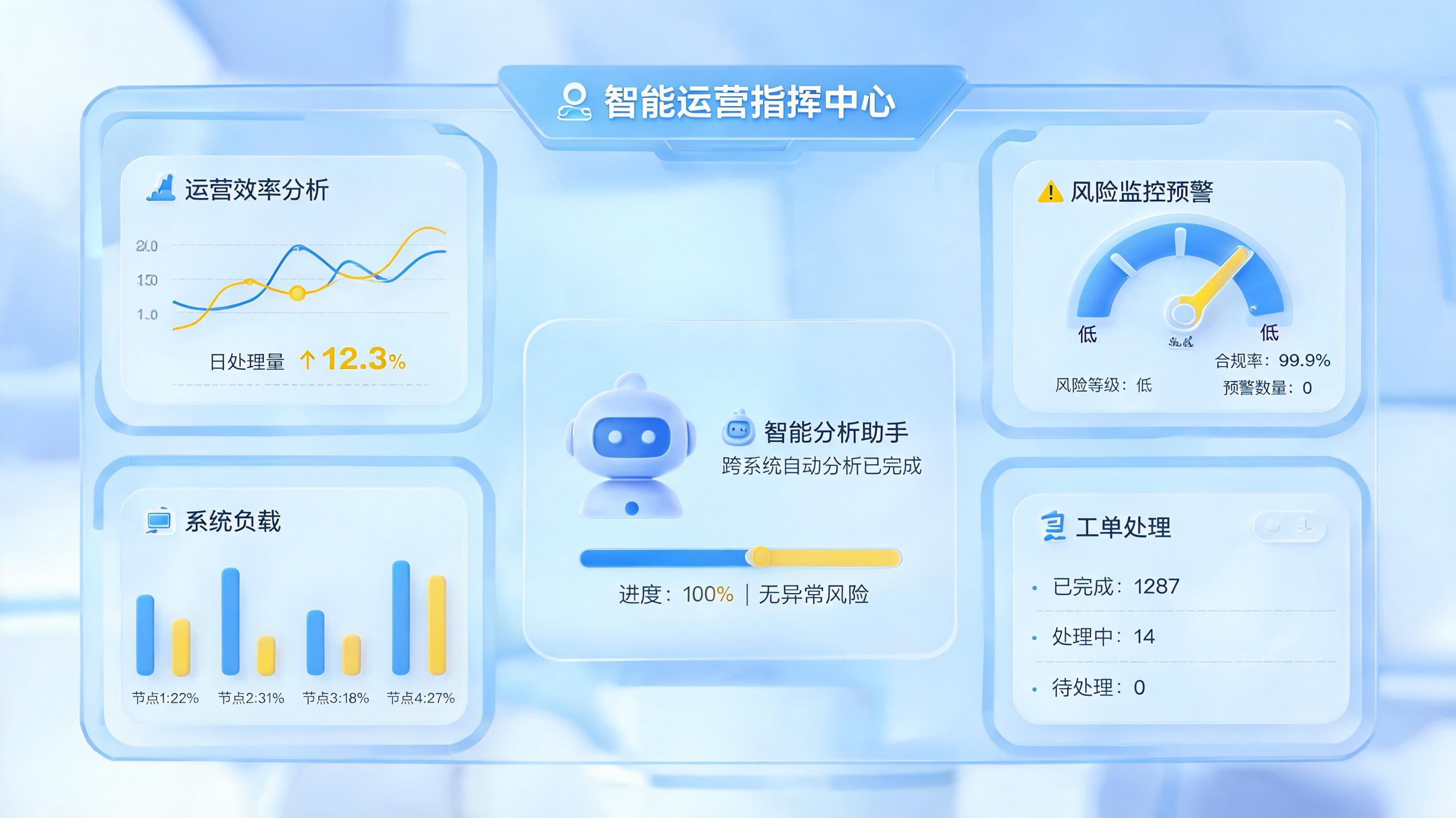

企业级防御机制与实在Agent的替代方案

企业在构建业务流时,如果直连外部公网的开源模型或非受控的搜索引擎API,将不可避免地面临媒体平台虚假稿件的投毒敞口。

-

RAG(检索增强生成)数据源控制:防御的核心在于建立高强度的数据隔离墙。剥夺大模型自由调取公网数据的权限,将其能力限制在企业本地审核通过的白名单知识库内。

-

实在Agent的隔离架构优势:作为一套成熟的本地化调度引擎,实在Agent的安全优势在于其执行前提能够与公网脏数据进行物理切断。其底层采用图形化RPA(机器人流程自动化)组件结合本地大模型推理,所有指令下发与文件读取均限定在企业内网的只读或受控存储节点中。切断了外部不可信媒体站点数据的反向注入通道,从源头阻断了模型被信息流投毒的逻辑链路。

❓ FAQ

Q:媒体平台发假稿对不联网的基础大模型有影响吗?

A:存在滞后影响。不联网的模型虽然当下不会抓取这些假稿件,但AI研发机构在进行下一代模型迭代(如跨越版本号重新训练)时,往往会重新爬取互联网最新语料。这些留存在媒体平台上的假稿最终会混入新的底层训练集。

Q:企业如何检测部署的模型是否已被投毒?

A:工程化实践中主要通过三种路径:建立绝对纯净的验证集(Validation Set)进行高频清洗校验、引入模型鲁棒性对抗测试(Red Teaming),以及采用多模型交叉验证机制(使用独立的审计模型来审查业务模型的输出逻辑)。